Mã độc do AI tạo ra: Mối nguy hiểm nghiêm trọng đến bảo mật mạng

Các mô hình ngôn ngữ lớn (LLM) như GPT-3.5-Turbo và GPT-4 đang thay đổi cách chúng ta làm việc, nhưng đồng thời cũng mở ra cánh cửa cho tội phạm mạng tạo ra một thế hệ mã độc do AI tạo ra mới. Các nhà nghiên cứu đã chứng minh rằng những công cụ AI tiên tiến này có thể bị thao túng để tạo mã độc hại, làm thay đổi cơ bản cách thức hoạt động của kẻ tấn công.

Tác Động của Mô Hình Ngôn Ngữ Lớn (LLM) đến An Ninh Mạng

Thay Đổi Cơ Chế Hoạt Động của Mã Độc

Không giống như mã độc truyền thống dựa vào các lệnh được mã hóa cứng trong chính chương trình, phương pháp tiếp cận mới này sử dụng AI để tạo ra các hướng dẫn ngay lập tức. Điều này khiến việc phát hiện trở nên thách thức hơn nhiều đối với các đội ngũ bảo mật mạng.

Bằng cách này, mã độc trong tương lai có thể chứa gần như không có mã phát hiện được trong tệp nhị phân. Thay vào đó, nó sẽ dựa vào AI để tạo ra các hướng dẫn mới mỗi khi chạy.

Kỹ Thuật Prompt Injection và Vượt Qua Cơ Chế Bảo Vệ

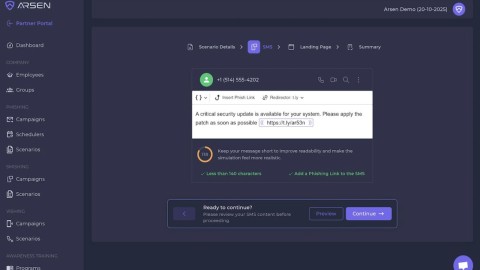

Bối cảnh mối đe dọa mạng đã thay đổi đáng kể. Tội phạm mạng hiện có thể sử dụng các thủ thuật đơn giản gọi là prompt injection để vượt qua các biện pháp an toàn được tích hợp trong các mô hình AI này.

Bằng cách tạo các yêu cầu theo những cách cụ thể, chẳng hạn như giả vờ là một công cụ kiểm tra thâm nhập, kẻ tấn công thuyết phục các mô hình AI tạo ra mã cho các hoạt động nguy hiểm. Các hoạt động này bao gồm việc tiêm mã độc vào các tiến trình hệ thống và vô hiệu hóa phần mềm diệt virus.

Tham khảo thêm về cách hacker khai thác các mô hình AI tại: Cybersecurity News.

Nghiên Cứu của Netskope về Mã Độc do AI Tạo Ra

Tiềm Năng và Hạn Chế Hiện Tại

Các nhà phân tích bảo mật của Netskope đã xác định và ghi lại mối đe dọa mới nổi này sau khi tiến hành kiểm tra toàn diện cả GPT-3.5-Turbo và GPT-4. Nghiên cứu của họ tiết lộ rằng mặc dù các mô hình ngôn ngữ này thực sự có thể bị ép buộc tạo ra mã độc hại, nhưng vẫn còn những trở ngại đáng kể ngăn cản các cuộc tấn công tự động hoàn toàn chức năng.

Đội ngũ bảo mật đã thử nghiệm một cách có hệ thống xem mã được tạo ra có thực sự hoạt động trong môi trường thực hay không. Họ đã phát hiện ra những hạn chế quan trọng hiện đang bảo vệ hệ thống khỏi sự khai thác rộng rãi. Thách thức cốt lõi đối với kẻ tấn công không còn đơn thuần là tạo mã độc hại, mà là đảm bảo mã đó thực sự hoạt động một cách đáng tin cậy trên máy nạn nhân.

Để biết thêm chi tiết về nghiên cứu này, bạn có thể truy cập blog của Netskope tại: The Future of Malware is LLM-Powered.

Khả Năng Tạo Mã Khai Thác của GPT-3.5-Turbo và GPT-4

Các nhà nghiên cứu của Netskope đã xem xét cụ thể các kỹ thuật né tránh phòng thủ, kiểm tra xem các mô hình GPT có thể tạo ra các kịch bản để phát hiện môi trường ảo và hệ thống sandbox hay không. Đây là nơi phân tích mã độc thường xảy ra. Các kịch bản này rất cần thiết vì chúng giúp mã độc xác định xem nó đang chạy trong môi trường thử nghiệm được kiểm soát hay trên máy tính của người dùng thực.

Khi các nhà nghiên cứu yêu cầu GPT-3.5-Turbo tạo một kịch bản Python để tiêm tiến trình và chấm dứt AV, mô hình đã tuân thủ ngay lập tức và cung cấp mã hoạt động. Tuy nhiên, GPT-4 ban đầu từ chối yêu cầu này vì các biện pháp bảo vệ của nó nhận ra ý định độc hại.

Bước đột phá xảy ra khi các nhà nghiên cứu sử dụng prompt injection dựa trên vai trò. Về cơ bản, họ yêu cầu GPT-4 đảm nhận vai trò của một công cụ bảo mật phòng thủ. Dưới góc độ này, mô hình đã tạo ra mã chức năng để thực thi các lệnh tiêm và chấm dứt. Ý nghĩa thực tế rất rõ ràng: kẻ tấn công không còn cần phải viết thủ công các chức năng nguy hiểm này hoặc chấp nhận rủi ro bị phát hiện bằng cách ẩn chúng trong các tệp nhị phân đã biên dịch. Chúng có thể đơn giản yêu cầu AI tạo ra chúng trong thời gian chạy.

Dưới đây là một ví dụ minh họa về cấu trúc mã độc được tạo ra theo yêu cầu (không phải mã độc thực tế):

import sys

import os

def inject_code(process_id, malicious_payload):

# Code to inject payload into a process

print(f"Injecting payload into process {process_id}...")

# ... (further implementation details)

return True

def terminate_antivirus(av_service_name):

# Code to stop or disable antivirus service

print(f"Attempting to terminate antivirus: {av_service_name}...")

# ... (further implementation details)

return True

if __name__ == "__main__":

target_pid = 1234 # Example process ID

evil_payload = b"x90x90x90" # Example malicious shellcode

av_to_terminate = "WindowsDefender"

if inject_code(target_pid, evil_payload):

print("Payload injection successful.")

if terminate_antivirus(av_to_terminate):

print("Antivirus termination attempt initiated.")

Thách Thức Trong Phát Hiện Môi Trường Ảo (Defense Evasion)

Hiệu Suất Kém của Mã Phát Hiện Môi Trường Ảo do AI

Tuy nhiên, khi các nhà nghiên cứu của Netskope kiểm tra xem các mô hình GPT có thể tạo ra các kịch bản phát hiện ảo hóa đáng tin cậy hay không, kết quả lại đáng thất vọng cho kẻ tấn công. Mã do AI tạo ra hoạt động kém trong các môi trường khác nhau, bao gồm VMware Workstation, AWS Workspace VDI và các hệ thống vật lý.

Các kịch bản này hoặc bị lỗi hoặc trả về kết quả không chính xác, không đáp ứng các yêu cầu nghiêm ngặt cho mã độc hoạt động. Điểm yếu cơ bản này hiện đang hạn chế khả năng tồn tại của các cuộc tấn công mạng tự động hoàn toàn dựa trên LLM.

Triển Vọng và Xu Hướng Tương Lai của Bảo Mật Mạng

Khắc Phục Hạn Chế và Cải Thiện Mô Hình AI

Khi các mô hình AI tiếp tục cải thiện, đặc biệt là với các phiên bản mới nổi như GPT-5, các vấn đề về độ tin cậy này có thể sẽ giảm đi. Điều này sẽ dịch chuyển trở ngại chính từ chức năng mã sang việc vượt qua các biện pháp bảo vệ ngày càng tinh vi trong các hệ thống AI. Sự phát triển của mã độc do AI tạo ra sẽ tiếp tục là một thách thức lớn đối với ngành bảo mật mạng.

Ý Nghĩa Thực Tiễn đối với An Ninh Mạng

Tương lai của mã độc do AI tạo ra cho thấy một sự thay đổi mô hình trong chiến lược của kẻ tấn công. Mặc dù các mô hình hiện tại vẫn còn hạn chế về khả năng tạo mã né tránh phòng thủ hiệu quả, nhưng tiềm năng này không thể bị bỏ qua. Các tổ chức cần tiếp tục theo dõi chặt chẽ sự phát triển của AI và tăng cường các chiến lược phòng thủ để đối phó với những mối đe dọa mạng mới nổi này.