Cảnh báo: Lỗ hổng chuỗi cung ứng AI dẫn đến RCE nghiêm trọng

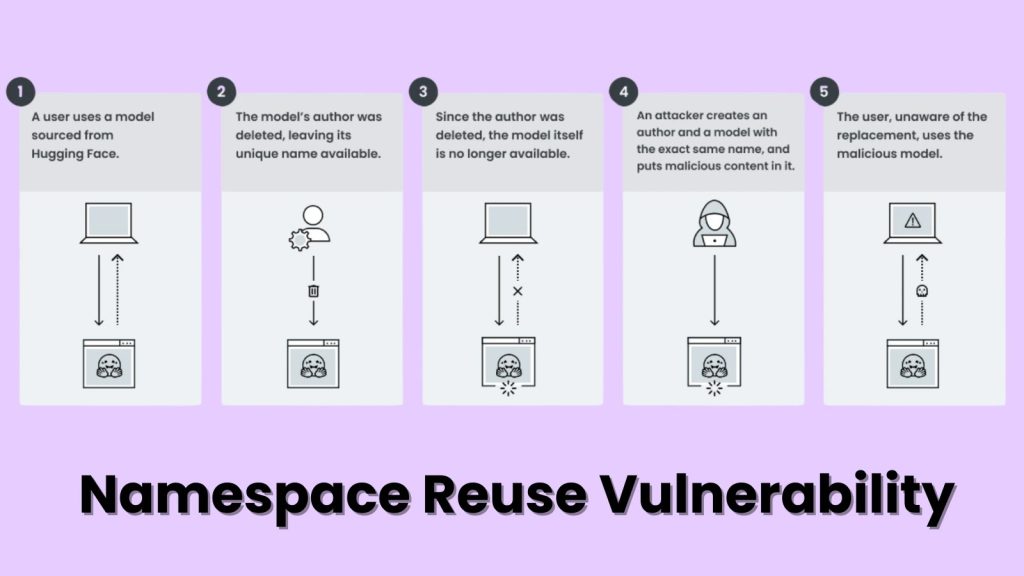

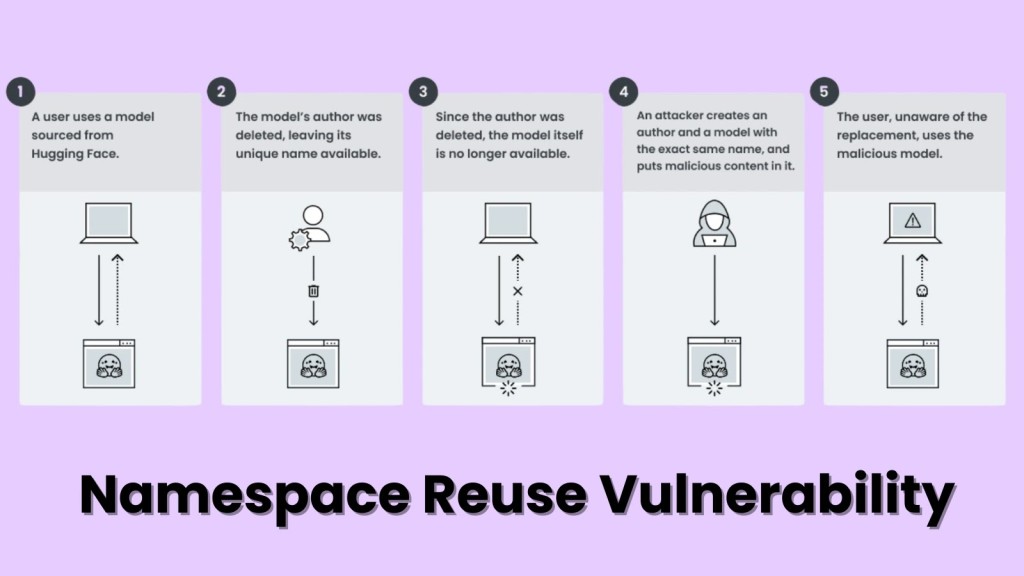

Một lỗ hổng chuỗi cung ứng AI mới được phát hiện, mang tên Model Namespace Reuse, cho phép kẻ tấn công thực hiện Remote Code Execution (RCE) trên các nền tảng AI lớn. Các nền tảng bị ảnh hưởng bao gồm Microsoft Azure AI Foundry, Google Vertex AI và hàng nghìn dự án mã nguồn mở. Việc tái đăng ký các namespace mô hình bị bỏ quên hoặc đã xóa trên Hugging Face có thể lừa các pipeline truy xuất mô hình theo tên, dẫn đến việc triển khai các kho lưu trữ độc hại, làm tổn hại môi trường endpoint và cấp quyền truy cập trái phép.

Model Namespace Reuse: Bản chất và cơ chế khai thác

Hugging Face lưu trữ các mô hình AI dưới dạng kho lưu trữ Git, được xác định bởi định danh Author/ModelName. Khi một tài khoản tác giả bị xóa hoặc quyền sở hữu mô hình được chuyển giao, các namespace ban đầu này sẽ trở lại trạng thái sẵn sàng để đăng ký lại. Việc chỉ dựa vào tên mô hình đáng tin cậy là không đủ để đảm bảo an toàn.

Cơ chế tấn công chi tiết

Model Namespace Reuse khai thác điểm yếu này bằng cách cho phép bất kỳ ai đăng ký lại namespace bị bỏ trống và tái tạo đường dẫn của nó. Các pipeline tham chiếu mô hình chỉ bằng tên sẽ sau đó truy xuất mô hình của kẻ tấn công thay vì mô hình gốc.

Các nhà phát triển thường sử dụng đoạn mã tương tự như sau để tải mô hình:

from transformers import AutoModel

model = AutoModel.from_pretrained("Author/ModelName")Quy ước hai phần (tên tác giả và tên mô hình) này giả định rằng namespace vẫn do nhà xuất bản gốc kiểm soát. Tuy nhiên, nếu thiếu các biện pháp kiểm soát vòng đời, một namespace bị bỏ rơi có thể bị chiếm đoạt, âm thầm thay thế mô hình hợp pháp trong các triển khai hạ nguồn.

Hậu quả của việc khai thác

Các mô hình độc hại có thể dẫn đến nhiều hậu quả không mong muốn. Từ việc chẩn đoán sai, đến việc kẻ tấn công duy trì quyền truy cập trái phép liên tục vào các hệ thống bị ảnh hưởng. Đây là một rủi ro nghiêm trọng đối với an ninh mạng AI.

Minh chứng khai thác trên các nền tảng AI lớn

Nhóm nghiên cứu đã thực hiện các Proof-of-Concept (PoC) trên các nền tảng AI hàng đầu để chứng minh tính khả thi của cuộc tấn công này.

Google Vertex AI

Model Garden của Vertex AI tích hợp các mô hình Hugging Face cho phép triển khai chỉ bằng một cú nhấp chuột. Chúng tôi đã tìm thấy một số mô hình “đã xác minh” mà tác giả gốc của chúng đã bị xóa trên Hugging Face. Bằng cách đăng ký lại một namespace như vậy và tải lên một mô hình được cài đặt backdoor, chúng tôi đã nhúng một payload reverse shell.

Sau khi triển khai trên Vertex AI, chúng tôi đã có quyền truy cập shell vào môi trường container hóa của endpoint. Google hiện đã bắt đầu quét hàng ngày các namespace mồ côi, đánh dấu chúng là “xác minh không thành công” để chặn triển khai. Điều này cho thấy mức độ nghiêm trọng của lỗ hổng chuỗi cung ứng AI này.

Microsoft Azure AI Foundry

Model Catalog của Azure AI Foundry cũng tương tự, lấy các mô hình từ Hugging Face. Chúng tôi đã xác định được các namespace có thể tái sử dụng, nơi tác giả đã bị xóa nhưng mô hình vẫn có thể triển khai được. Việc đăng ký một namespace không có chủ và tải lên một mô hình độc hại đã tạo ra một reverse shell tại endpoint, mang lại điểm đặt chân ban đầu vào môi trường Azure. Microsoft đã được thông báo và đang đánh giá các biện pháp bảo vệ.

Mối đe dọa với các dự án mã nguồn mở và Registry thứ cấp

Việc quét GitHub để tìm mã truy xuất các mô hình Hugging Face đã phát hiện ra hàng nghìn kho lưu trữ tham chiếu các định danh Author/ModelName dễ bị tấn công. Nhiều dự án phổ biến đã mã hóa cứng các mô hình mặc định mà kẻ tấn công có thể đòi lại, biến các triển khai hạ nguồn thành độc hại. Đây là một nguy cơ tấn công mạng đáng kể.

Ngoài việc tải trực tiếp từ Hugging Face, các registry thứ cấp – như Model Catalog của Kaggle và các registry mô hình riêng tư khác – cũng có thể nạp các mô hình dễ bị tấn công. Người dùng truy xuất từ các registry này thừa hưởng cùng một rủi ro, dù không tương tác trực tiếp với Hugging Face nhưng vẫn bị phơi nhiễm. Trong các kịch bản chuyển giao, việc chuyển hướng có thể che giấu rủi ro cho đến khi kẻ tấn công đòi lại namespace cũ và phá vỡ chuyển hướng.

Biện pháp phòng ngừa và bảo vệ chuỗi cung ứng AI

Lỗ hổng chuỗi cung ứng AI này đòi hỏi các tổ chức phải hành động khẩn cấp để củng cố các biện pháp bảo mật AI của mình. Việc chỉ dựa vào định danh namespace để xác định độ tin cậy là không đủ.

Khuyến nghị hành động cho tổ chức và nhà phát triển

- Hạn chế tin cậy vào định danh namespace: Không chỉ dựa vào tên namespace để xác định tính hợp lệ của mô hình.

- Sử dụng hash nội dung đầy đủ: Xác minh mô hình bằng hash SHA-256 hoặc các cơ chế kiểm tra tính toàn vẹn khác.

- Triển khai registry mô hình riêng tư: Quản lý các mô hình nội bộ trong các môi trường được kiểm soát.

- Sử dụng mô hình được ký số: Đảm bảo tính xác thực và không bị thay đổi của các gói mô hình.

- Quét liên tục các thành phần: Áp dụng các công cụ quét chuỗi cung ứng phần mềm (SCA) để phát hiện lỗ hổng.

- Tăng cường kiểm soát vòng đời namespace: Các nhà cung cấp nền tảng cần cải thiện chính sách quản lý namespace.

- Thực hành xác minh nghiêm ngặt: Nhà phát triển cần áp dụng các biện pháp xác minh chặt chẽ hơn cho các mô hình bên ngoài.

Đây là một lỗ hổng hệ thống trong phân phối mô hình AI. Hành động hợp tác giữa các nhà cung cấp nền tảng và nhà phát triển là điều cần thiết để bảo vệ hệ sinh thái AI chống lại các cuộc tấn công mạng chuỗi cung ứng, đặc biệt là các cuộc tấn công nhằm thực hiện Remote Code Execution (RCE).