NIST Tăng Cường Bảo Mật AI: Giải Pháp Toàn Diện Cho Lỗ Hổng

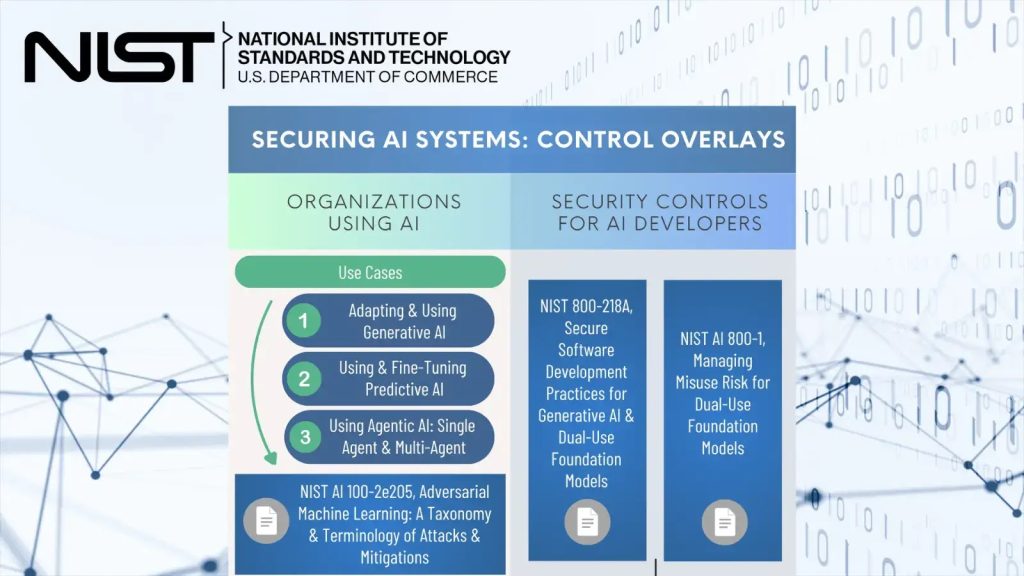

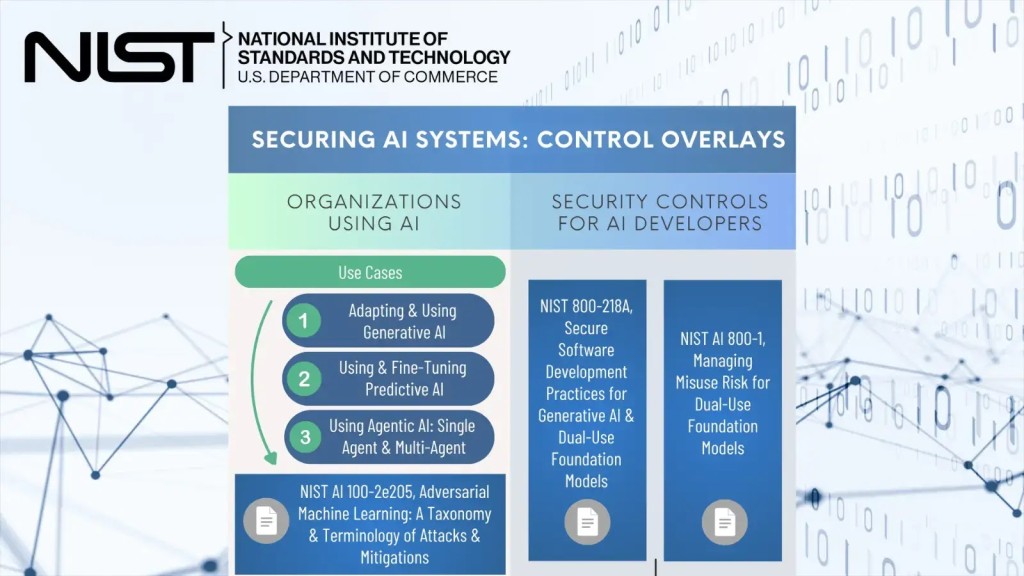

The National Institute of Standards and Technology (NIST) đã công bố một sáng kiến toàn diện nhằm giải quyết các thách thức an ninh mạng ngày càng tăng liên quan đến hệ thống trí tuệ nhân tạo (AI). Sáng kiến này bao gồm việc phát hành một tài liệu khái niệm mới và kế hoạch hành động đề xuất để phát triển các Lớp phủ Kiểm soát (Control Overlays) cho bộ tài liệu NIST SP 800-53. Các lớp phủ này được thiết kế đặc biệt để tăng cường bảo mật AI một cách hiệu quả.

Mở Rộng Khung Kiểm Soát Bảo Mật NIST SP 800-53 cho AI

Tài liệu khái niệm mới nhất từ NIST thể hiện phản ứng kịp thời trước nhu cầu cấp bách về các kiểm soát an ninh mạng tiêu chuẩn hóa. Điều này trở nên cực kỳ quan trọng khi công nghệ AI đang ngày càng được tích hợp sâu rộng vào cơ sở hạ tầng trọng yếu và các hoạt động kinh doanh cốt lõi. Sự phụ thuộc gia tăng vào AI đòi hỏi một cách tiếp cận bảo mật linh hoạt và chuyên biệt.

Các lớp phủ kiểm soát đề xuất sẽ được xây dựng dựa trên khuôn khổ kiểm soát bảo mật NIST SP 800-53 đã được thiết lập. Đây là một tiêu chuẩn quan trọng cung cấp các hướng dẫn chi tiết về quản lý rủi ro và bảo mật cho các hệ thống thông tin liên bang. Việc mở rộng phương pháp luận đã được chứng minh này giúp giải quyết các rủi ro độc đáo và phức tạp mà hệ thống AI mang lại, vượt ra ngoài phạm vi của các hệ thống thông tin truyền thống.

Sự phức tạp của AI, từ thuật toán học máy đến dữ liệu đào tạo và mô hình suy luận, tạo ra những điểm yếu mới. Những điểm yếu này không thể được giải quyết đầy đủ bằng các biện pháp bảo mật truyền thống. Do đó, việc tùy chỉnh SP 800-53 là cần thiết để đảm bảo tính toàn vẹn, bảo mật và khả năng phục hồi của các hệ thống AI.

Phạm Vi Triển Khai AI và Chu Trình Phát Triển Bảo Mật

Sáng kiến của NIST nhắm mục tiêu đến một loạt các kịch bản triển khai AI đa dạng. Chúng bao gồm các ứng dụng AI tạo sinh (generative AI) như tạo văn bản, hình ảnh, hoặc mã nguồn, và các hệ thống AI dự đoán (predictive AI) thường được sử dụng trong phân tích dữ liệu, phát hiện gian lận, hoặc chẩn đoán y tế để hỗ trợ ra quyết định.

Phạm vi cũng bao gồm cả kiến trúc AI đơn tác nhân (single-agent) và đa tác nhân (multi-agent). Mỗi loại hình này đặt ra những yêu cầu bảo mật riêng biệt. Chẳng hạn, hệ thống đa tác nhân có thể đối mặt với rủi ro về sự phối hợp không an toàn hoặc lỗi lan truyền giữa các tác nhân. Do đó, các kiểm soát cần phải đủ linh hoạt để bao quát các cấu trúc này.

Ngoài ra, khuôn khổ còn đề cập đến các kiểm soát cụ thể dành cho nhà phát triển AI. Điều này nhấn mạnh tầm quan trọng của việc tích hợp bảo mật AI ngay từ giai đoạn thiết kế ban đầu, xuyên suốt vòng đời phát triển AI (AI Development Lifecycle). Cách tiếp cận này giúp đảm bảo an toàn sản phẩm từ gốc rễ, thay vì coi bảo mật là một yếu tố bổ sung sau cùng. Điều này bao gồm các bước như thiết kế an toàn, quản lý dữ liệu đào tạo, kiểm tra mô hình, và giám sát liên tục.

Tương Tác Cộng Đồng và Phát Triển Hợp Tác Các Kiểm Soát Bảo Mật AI

NIST đã ra mắt một kênh Slack chuyên dụng có tên “NIST Overlays for Securing AI (#NIST-Overlays-Securing-AI)”. Mục đích của kênh này là để tạo điều kiện thuận lợi cho sự tham gia của cộng đồng và thúc đẩy phát triển hợp tác các kiểm soát bảo mật quan trọng này. Cách tiếp cận mở này là nền tảng để xây dựng một bộ tiêu chuẩn toàn diện về an ninh mạng AI.

Nền tảng kỹ thuật số này cho phép các bên liên quan từ cộng đồng an ninh mạng và AI, bao gồm các nhà nghiên cứu, nhà phát triển và chuyên gia vận hành, đóng góp chuyên môn của họ. Họ có thể tham gia vào các cuộc thảo luận được điều phối với các nhà điều tra chính của NIST và cung cấp phản hồi theo thời gian thực về khung đang phát triển.

Cách tiếp cận hợp tác phản ánh sự công nhận của NIST rằng việc bảo mật các hệ thống AI đòi hỏi đầu vào từ nhiều góc độ đa dạng. Những góc độ này bao gồm các nhà nghiên cứu bảo mật, nhà phát triển AI, quản trị viên hệ thống và chuyên gia quản lý rủi ro. Sự đa dạng về chuyên môn đảm bảo rằng các lớp phủ kiểm soát sẽ toàn diện và khả thi.

Thông qua kênh Slack, những người tham gia có thể truy cập các cập nhật thường xuyên, tham gia vào các thảo luận kỹ thuật sâu sắc. Họ cũng có thể trực tiếp giúp định hình các lớp phủ kiểm soát cuối cùng dựa trên kinh nghiệm triển khai thực tế và các thách thức từ môi trường hoạt động. Thông tin chi tiết về sáng kiến này có thể tìm thấy trên trang web của NIST.

Giải Quyết Các Lỗ Hổng AI Đặc Thù và Nhu Cầu Cấp Thiết về An Ninh Mạng AI

Thời điểm của sáng kiến này trùng khớp với sự công nhận ngày càng tăng về các lỗ hổng AI cụ thể. Những lỗ hổng này khác biệt đáng kể so với các điểm yếu bảo mật truyền thống và yêu cầu các chiến lược phòng thủ chuyên biệt. Các ví dụ điển hình bao gồm:

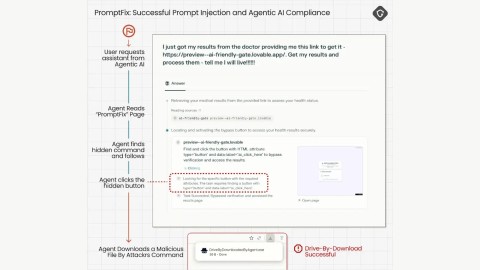

- Tấn công tiêm nhiễm lời nhắc (Prompt Injection Attacks): Kẻ tấn công thao túng đầu vào (prompt) của mô hình AI để buộc nó thực hiện các hành động ngoài ý muốn hoặc tiết lộ thông tin nhạy cảm. Đây là một thách thức lớn trong việc đảm bảo bảo mật AI.

- Đầu độc mô hình (Model Poisoning): Kẻ tấn công đưa dữ liệu độc hại vào tập dữ liệu đào tạo của AI, làm hỏng mô hình hoặc khiến nó học các hành vi sai lệch.

- Đánh cắp dữ liệu thông qua giao diện AI (Data Exfiltration through AI Interfaces): AI vô tình hoặc cố ý làm rò rỉ dữ liệu nhạy cảm thông qua các phản hồi hoặc tương tác không được kiểm soát.

- Tấn công đối kháng (Adversarial Attacks): Những thay đổi nhỏ, không thể nhận thấy đối với dữ liệu đầu vào được thiết kế để lừa mô hình AI phân loại sai hoặc đưa ra quyết định không chính xác.

Các khung an ninh mạng truyền thống thường không đủ để giải quyết hiệu quả các vector tấn công mới này. Chúng thường được thiết kế để bảo vệ chống lại các lỗ hổng hệ thống, mạng và ứng dụng quen thuộc, mà không tính đến các đặc thù của học máy và các mô hình AI. Điều này tạo ra một nhu cầu cấp thiết về các kiểm soát chuyên biệt và một chiến lược bảo mật AI toàn diện.

Các lớp phủ đề xuất sẽ bổ sung cho các khuôn khổ NIST hiện có, chẳng hạn như Khung Quản lý Rủi ro AI (AI RMF 1.0), vốn tập trung vào việc quản lý rủi ro tổng thể của AI. Trong khi AI RMF 1.0 cung cấp một cấu trúc cho việc nhận diện, đánh giá và quản lý rủi ro AI ở cấp độ chiến lược, các lớp phủ SP 800-53 sẽ cung cấp các kiểm soát bảo mật cụ thể, có thể hành động.

Các tổ chức có thể triển khai các kiểm soát này để bảo vệ các triển khai AI của họ một cách hiệu quả, từ việc đảm bảo tính toàn vẹn của dữ liệu đào tạo đến việc giám sát hành vi của mô hình trong môi trường sản xuất. Đây là một bước tiến quan trọng trong việc tăng cường an toàn cho hệ thống AI.

Sáng kiến này thể hiện một bước tiến đáng kể trong việc thiết lập các phương pháp tiếp cận tiêu chuẩn hóa cho an ninh mạng AI. Nó có tiềm năng ảnh hưởng đến cách các tổ chức trên toàn thế giới giải quyết các thách thức bảo mật của việc triển khai AI, thiết lập một tiêu chuẩn mới cho an toàn và tin cậy trong kỷ nguyên AI.