Mối đe dọa mạng nghiêm trọng: DIG AI tự động hóa tấn công

Trong bối cảnh “Shadow AI” đang mở rộng nhanh chóng, một thực thể mới và đầy đe dọa đã xuất hiện: DIG AI. Các nhà nghiên cứu tại Resecurity đã xác định DIG AI là một công cụ trí tuệ nhân tạo không kiểm duyệt, được lưu trữ trên darknet, đang trao quyền cho các tác nhân đe dọa tự động hóa các tấn công mạng, tạo ra nội dung bất hợp pháp và vượt qua các rào cản an toàn của các mô hình AI truyền thống. Sự phát triển này đại diện cho một mối đe dọa mạng đáng kể, làm giảm rào cản gia nhập cho các cuộc tấn công mạng tinh vi.

Sự Trỗi Dậy Của DIG AI: Công Cụ AI Đen Tối

DIG AI lần đầu tiên được phát hiện vào ngày 29 tháng 9 năm 2025 và đã chứng kiến sự gia tăng đáng kể về mức độ phổ biến trong quý 4, đặc biệt là trong mùa lễ hội cuối năm. Sự gia tăng này cho thấy sự chấp nhận nhanh chóng của công cụ trong cộng đồng tội phạm mạng.

Sự phát triển của DIG AI đánh dấu một sự leo thang đáng kể trong “tội phạm hóa AI” (criminalization of AI). Điều này làm cho việc thực hiện các cuộc tấn công mạng phức tạp trở nên dễ dàng hơn, đặt ra những rủi ro nghiêm trọng trước các sự kiện toàn cầu lớn vào năm 2026, bao gồm Thế vận hội Mùa đông ở Milan và Giải vô địch bóng đá thế giới FIFA World Cup.

Tính Năng Cốt Lõi Và Rủi Ro Từ DIG AI

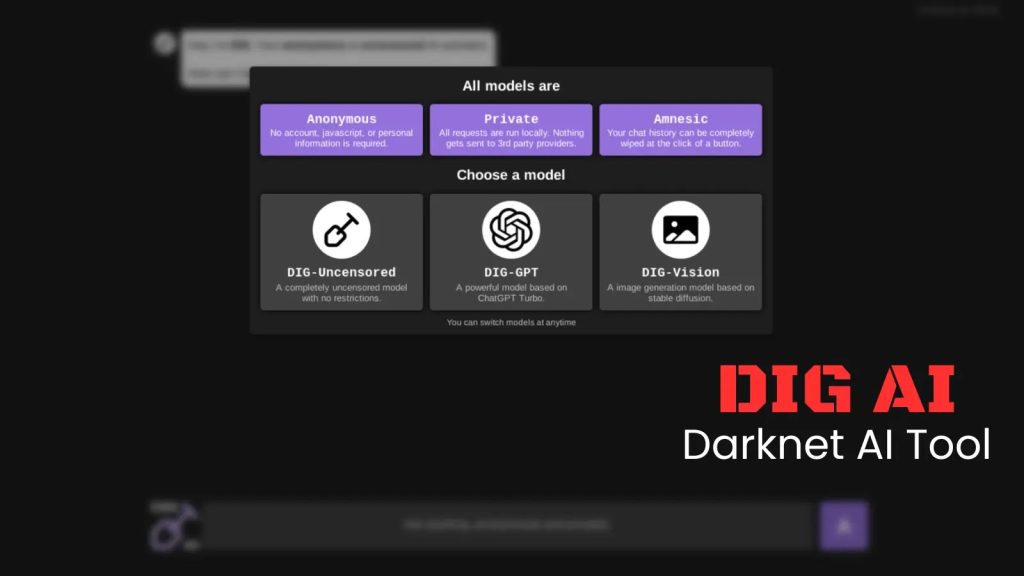

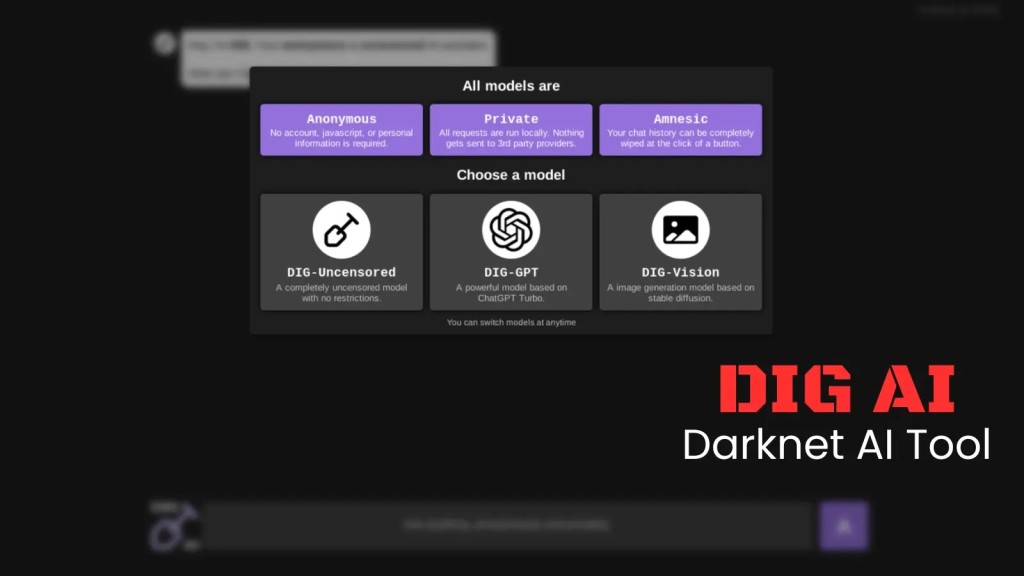

Thiết Kế Ẩn Danh Và Không Kiểm Duyệt

Không giống như các nền tảng hợp pháp tuân thủ các nguyên tắc đạo đức nghiêm ngặt, DIG AI được thiết kế rõ ràng để không có bất kỳ quy định kiểm duyệt nào. Công cụ này có thể truy cập thông qua mạng Tor và không yêu cầu đăng ký tài khoản, đảm bảo tính ẩn danh hoàn toàn cho người dùng.

Người điều hành công cụ, một tác nhân đe dọa được biết đến với biệt danh “Pitch”, tích cực quảng bá dịch vụ này trên các chợ đen ngầm, cùng với các mặt hàng như ma túy và dữ liệu tài chính bị đánh cắp.

Tự Động Hóa Tấn Công Mạng Và Tạo Mã Độc

Một trong những khả năng đáng báo động nhất của DIG AI là khả năng tạo ra mã độc chức năng. Các nhà phân tích của Resecurity đã sử dụng công cụ này để tạo ra các backdoor JavaScript được che giấu, nhằm mục đích xâm nhập các ứng dụng web.

Các ảnh chụp màn hình về công cụ khi hoạt động cho thấy nó xử lý các yêu cầu “tạo và che giấu script độc hại” (generate and obfuscate malicious script), tạo ra các mã được thiết kế để hoạt động lén lút và khó bị phát hiện. Loại mã độc này có thể được tùy chỉnh để phù hợp với nhiều kịch bản tấn công khác nhau.

Đầu ra được tạo ra hoạt động như một web shell, cho phép kẻ tấn công đánh cắp dữ liệu người dùng, chuyển hướng lưu lượng truy cập đến các trang web lừa đảo (phishing) hoặc tiêm nhiễm thêm các mã độc khác vào hệ thống.

Mặc dù các hoạt động phức tạp như che giấu mã có thể mất từ 3-5 phút do tài nguyên điện toán hạn chế, các tác giả của DIG AI cung cấp các dịch vụ “có phí” cao cấp để giảm thiểu sự chậm trễ này, hình thành một mô hình “Crime-as-a-Service” (Tội phạm dưới dạng dịch vụ) cho AI.

Ứng Dụng Độc Hại Ngoài Không Gian Mạng

Ngoài tội phạm mạng, DIG AI còn bị vũ khí hóa để gây ra những tác hại nghiêm trọng trong thế giới thực. Công cụ này đã được quan sát là tạo ra các hướng dẫn chi tiết để sản xuất chất nổ và các loại thuốc cấm.

Quan trọng hơn cả, mô hình “DIG-Vision” tạo điều kiện cho việc tạo ra tài liệu lạm dụng tình dục trẻ em (CSAM – Child Sexual Abuse Material). Resecurity đã xác nhận rằng công cụ này có thể tạo ra hình ảnh tổng hợp siêu thực hoặc thao túng ảnh thực của trẻ vị thành niên, tạo ra một kịch bản kinh hoàng cho các nhà vận động an toàn trẻ em và cơ quan thực thi pháp luật. Các nhà phân tích của Resecurity nhấn mạnh rằng vấn đề này sẽ đặt ra một thách thức mới cho các nhà lập pháp, khi những kẻ phạm tội có thể chạy các mô hình trên cơ sở hạ tầng của riêng họ, tạo ra nội dung bất hợp pháp không giới hạn mà các nền tảng trực tuyến không thể phát hiện.

DIG AI Trong Bối Cảnh Các Công Cụ AI Độc Hại

DIG AI đại diện cho sự phát triển mới nhất của các công cụ “Not Good AI” (AI không tốt), thường được gọi là “Dark LLMs” (Mô hình ngôn ngữ lớn tối) hoặc các chatbot đã bị bẻ khóa (jailbroken chatbots). Theo bước chân của các phiên bản tiền nhiệm như FraudGPT và WormGPT, các công cụ này đang chứng kiến sự tăng trưởng bùng nổ.

Các đề cập về AI độc hại trên các diễn đàn tội phạm mạng đã tăng hơn 200% từ năm 2024 đến năm 2025. Điều này cho thấy sự chấp nhận và sử dụng ngày càng rộng rãi của mối đe dọa mạng mới này.

Khi năm 2026 đang đến gần, cộng đồng an ninh mạng phải đối mặt với một “lĩnh vực chiến tranh thứ năm”. Với khả năng tự động hóa các cuộc tấn công mạng và tạo ra vô số biến thể nội dung độc hại, cuộc chiến chống lại AI bị vũ khí hóa không còn là một dự đoán trong tương lai; đó là một thực tế khẩn cấp hiện tại, tạo nên một mối đe dọa mạng không ngừng leo thang.