Nguy hiểm: Lỗ hổng Gemini AI cho phép kiểm soát nhà thông minh

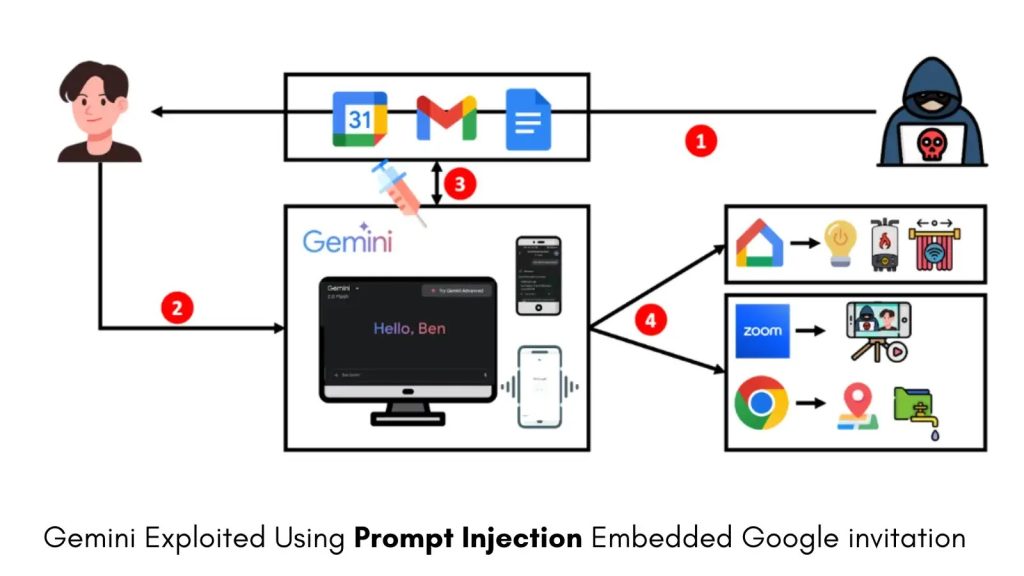

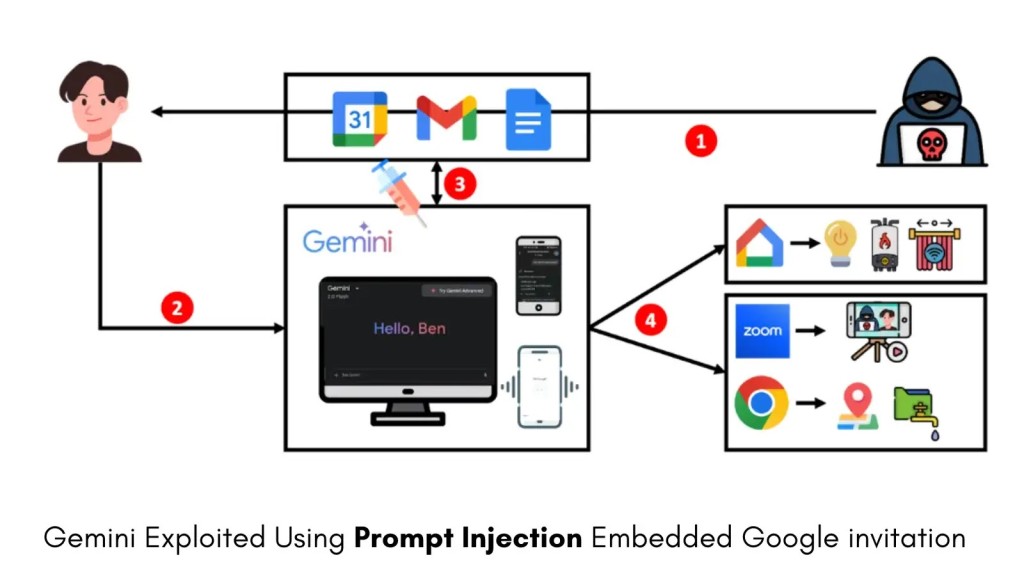

Các nhà nghiên cứu bảo mật đã phát hiện ra một loạt các lỗ hổng Gemini AI nghiêm trọng trong trợ lý Google Gemini AI. Những lỗ hổng này cho phép kẻ tấn công khai thác hệ thống thông qua các lời mời Google Calendar và email tưởng chừng vô hại, tiềm ẩn nguy cơ xâm phạm dữ liệu nhạy cảm của người dùng và thậm chí kiểm soát các thiết bị nhà thông minh của họ.

Nghiên cứu đột phá này tiết lộ một loại mối đe dọa mới, được gọi là “Targeted Promptware Attacks” (Tấn công Promptware Mục tiêu). Chúng tận dụng các kỹ thuật chèn prompt gián tiếp được nhúng trong các tương tác người dùng phổ biến.

Các Kỹ Thuật Tấn Công Mạng Mới: Promptware Mục Tiêu

Các cuộc tấn công tinh vi này có thể được kích hoạt khi người dùng hỏi trợ lý được hỗ trợ bởi Gemini về email, sự kiện lịch hoặc tài liệu được chia sẻ của họ. Trong quá trình này, người dùng vô tình kích hoạt mã độc hại được ẩn trong tiêu đề lời mời hoặc chủ đề email.

Kỹ thuật tấn công mạng này mở ra một vectơ tấn công mới, nơi các thông tin tưởng chừng vô hại lại trở thành cánh cổng cho việc thực thi mã độc.

Phân Loại Lỗ Hổng và Mức Độ Rủi Ro

Các nhà nghiên cứu đã phân loại các lỗ hổng được phát hiện thành năm lớp tấn công riêng biệt, mỗi lớp thể hiện mức độ rủi ro tăng dần. Nguồn nghiên cứu chi tiết có thể được tham khảo tại: Invitation Is All You Need.

Short-term Context Poisoning

Đây là điểm vào ban đầu, cho phép kẻ tấn công thao túng một phiên làm việc của người dùng thông qua nội dung độc hại trong các tài nguyên được chia sẻ. Đây là một phương pháp tấn công thoáng qua, chỉ ảnh hưởng đến phiên hiện tại.

Long-term Memory Poisoning

Phương pháp tấn công này có thể phát triển thành Long-term Memory Poisoning. Nó ảnh hưởng đến tính năng “Saved Info” (Thông tin Đã lưu) của Gemini, cho phép hoạt động độc hại kéo dài qua nhiều phiên độc lập. Điều này có nghĩa là tác động của cuộc tấn công không chỉ dừng lại ở một lần tương tác duy nhất.

Tool Misuse

Các phát hiện đáng lo ngại nhất liên quan đến Tool Misuse. Kẻ tấn công khai thác các công cụ tích hợp của Gemini để thực hiện các hành động trái phép, chẳng hạn như xóa các sự kiện lịch hoặc truy cập thông tin cá nhân. Điều này cho thấy khả năng thao túng các chức năng cốt lõi của hệ thống.

Automatic Agent Invocation

Đây là một mối đe dọa leo thang đặc quyền đáng kể. Lỗ hổng này cho phép kẻ tấn công kiểm soát các thiết bị nhà thông minh, bao gồm mở cửa sổ, kích hoạt hệ thống sưởi và điều khiển hệ thống chiếu sáng trong nhà nạn nhân. Khả năng chiếm quyền điều khiển Gemini AI để điều khiển thiết bị vật lý là một mối lo ngại lớn.

Automatic App Invocation

Lớp tấn công thứ năm, và có lẽ là xâm nhập nhất, là Automatic App Invocation. Nó cho phép kẻ tấn công khởi chạy các ứng dụng trên điện thoại thông minh của nạn nhân. Điều này có thể dẫn đến việc bắt đầu các cuộc gọi video trái phép, truy cập trình duyệt web hoặc đánh cắp dữ liệu email nhạy cảm. Đây là khả năng khiến lỗ hổng Gemini AI trở thành mối đe dọa toàn diện.

Ảnh Hưởng Thực Tế và Mối Đe Dọa Mở Rộng

Nghiên cứu đã chỉ ra những tác động đáng báo động trong thế giới thực, vượt ra ngoài các vụ rò rỉ dữ liệu thông thường. Các kịch bản tấn công bao gồm truyền phát video trái phép qua Zoom, theo dõi vị trí địa lý thông qua trình duyệt web, chiến dịch spam, hoạt động lừa đảo (phishing) và các chiến dịch thông tin sai lệch.

Đặc biệt nghiêm trọng, kẻ tấn công có thể thực hiện “on-device lateral movement” (di chuyển ngang trên thiết bị). Điều này cho phép chúng thoát khỏi ranh giới của ứng dụng AI để kích hoạt các hành động độc hại bằng cách sử dụng các ứng dụng khác trên thiết bị. Đây là một điểm nhấn về mức độ nguy hiểm của các lỗ hổng Gemini AI này.

Đánh Giá Rủi Ro và Biện Pháp Giảm Thiểu

Phân tích mối đe dọa và đánh giá rủi ro toàn diện (TARA) được thực hiện bởi các nhà nghiên cứu đã tiết lộ rằng 73% các mối đe dọa được phân tích đặt ra rủi ro Cao-Nghiêm trọng cho người dùng cuối. Đây là một con số đáng báo động, nhấn mạnh tầm quan trọng của việc cập nhật bản vá.

Tuy nhiên, các kết quả đánh giá rủi ro cũng chỉ ra rằng, với các biện pháp giảm thiểu phù hợp, những rủi ro này có thể được giảm đáng kể xuống mức Rất Thấp đến Trung Bình, nhấn mạnh tầm quan trọng của việc duy trì an toàn thông tin cho hệ thống.

Phản Ứng và Biện Pháp Đối Phó của Google

Google đã được thông báo về những phát hiện này và đã triển khai các biện pháp đối phó chuyên dụng để giải quyết các lỗ hổng Gemini AI được xác định. Phản ứng nhanh chóng của công ty làm nổi bật mức độ nghiêm trọng của các vectơ tấn công được phát hiện và tầm quan trọng của nghiên cứu bảo mật liên tục trong các ứng dụng được hỗ trợ bởi AI.

Nghiên cứu này nhấn mạnh bối cảnh mối đe dọa đang phát triển khi trí tuệ nhân tạo ngày càng được tích hợp vào các ứng dụng hàng ngày. Điều này cũng khẳng định sự cần thiết của các biện pháp bảo mật mạnh mẽ và sự cảnh giác liên tục trong quá trình phát triển hệ thống Gemini AI và các hệ thống AI khác.